Jacob Jackson estava totalmente envolvido com a IA no início de sua carreira. Jackson co-fundou o Tabnine, o assistente de codificação de IA que conseguiu levantar quase US$ 60 milhões em investimentos de capital de risco, enquanto ainda era estudante de ciência da computação na Universidade de Waterloo. Depois de vender o Tabnine para Codata em 2019 (durante seus exames finais), Jackson juntou-se à OpenAI como estagiário, onde trabalhou até 2022. Foi nesse momento que Jackson teve a vontade de iniciar uma empresa novamente, focada em apoiar fluxos de trabalho comuns de desenvolvedores.

Jacob Jackson estava totalmente envolvido com a IA no início de sua carreira. Jackson co-fundou o Tabnine, o assistente de codificação de IA que conseguiu levantar quase US$ 60 milhões em investimentos de capital de risco, enquanto ainda era estudante de ciência da computação na Universidade de Waterloo. Depois de vender o Tabnine para Codata em 2019 (durante seus exames finais), Jackson juntou-se à OpenAI como estagiário, onde trabalhou até 2022. Foi nesse momento que Jackson teve a vontade de iniciar uma empresa novamente, focada em apoiar fluxos de trabalho comuns de desenvolvedores. “Nos anos desde que construí o Tabnine, ferramentas como ChatGPT e Github Copilot mudaram a forma como os desenvolvedores trabalham”, disse Jackson ao TechCrunch. “É um momento muito empolgante para estar trabalhando em ferramentas para desenvolvedores, porque a tecnologia subjacente melhorou muito desde que comecei o Tabnine - o que levou a muito mais desenvolvedores interessados em usar ferramentas de IA para acelerar seu fluxo de trabalho.”

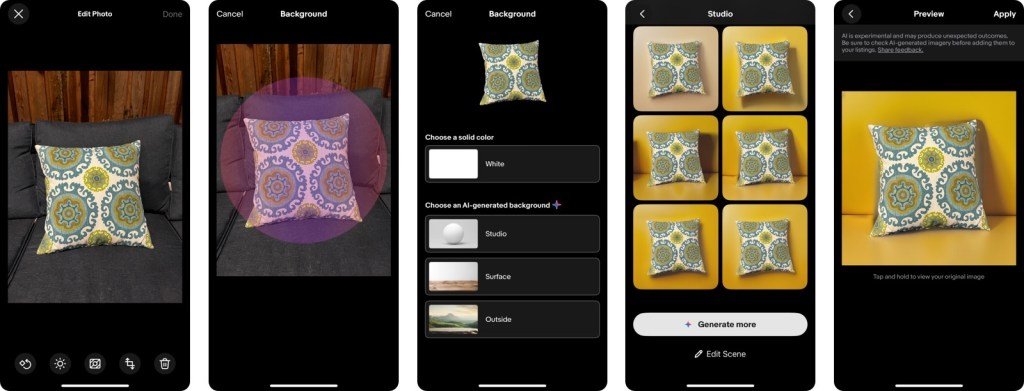

Então Jackson fundou o Supermaven, uma plataforma de codificação de IA nos moldes do Tabnine, mas com algumas melhorias na qualidade de vida e técnicas. O modelo de IA gerativo interno do Supermaven, Babble, pode entender muitos códigos de uma só vez, diz Jackson, graças a uma janela de contexto de 1 milhão de tokens. Em ciência de dados, tokens são subdivisões de dados brutos - como as sílabas “fan”, “tas” e “tic” na palavra “fantástico”.

O contexto de um modelo, ou janela de contexto, refere-se aos dados de entrada (por exemplo, código) que o modelo considera antes de gerar a saída (por exemplo, código adicional). O contexto longo pode evitar que os modelos “esqueçam” o conteúdo de documentos e dados recentes, e evitem sair do tópico e extrapolar erroneamente.

“Nossa grande janela de contexto ajuda a reduzir a frequência de alucinações, pois permite que o modelo extraia respostas do contexto em situações em que, de outra forma, teria que adivinhar”, disse Jackson.

Um milhão de tokens é realmente uma grande janela de contexto. Mas não é maior do que a da startup de codificação de IA Magic, que é de 100 milhões de tokens. Enquanto isso, a nova ferramenta Code Assist do Google corresponde ao contexto do Supermaven com 1 milhão de tokens.

Então, quais são as vantagens do Supermaven sobre os concorrentes? Bem, Jackson afirma que o Babble tem menor latência graças a uma “nova arquitetura neural”. Ele não quis elaborar, dizendo apenas que a arquitetura foi desenvolvida “do zero”.

“O Supermaven leva de 10 a 20 segundos para processar o repositório de código de um desenvolvedor e se familiarizar com suas APIs e as convenções únicas de sua base de códigos”, disse Jackson. “Com menor latência devido à nossa infraestrutura de modelos internos, nossa ferramenta permanece responsiva ao lidar com as solicitações longas que vêm com grandes bases de códigos.”

O mercado de ferramentas de codificação de IA é grande e está em crescimento, com a Polaris Research prevendo que valerá US$ 27,17 bilhões até 2032. A grande maioria dos entrevistados na última pesquisa de desenvolvedores do GitHub diz ter adotado ferramentas de IA de alguma forma, e mais de 1,8 milhão de pessoas - e cerca de 50.000 empresas - estão pagando pelo GitHub Copilot.

Mas o Supermaven - juntamente com concorrentes iniciantes como Cognition, Anysphere, Poolside, Codeium e Augment - tem desafios éticos e legais a superar.

As empresas geralmente têm receio de expor código proprietário a terceiros; por exemplo, a Apple supostamente proibiu os funcionários de usar o Copilot no ano passado, citando preocupações com vazamento de dados confidenciais. Algumas ferramentas geradoras de código treinadas com código restritivamente licenciado ou protegido por direitos autorais foram demonstradas regurgitar esse código quando solicitadas de certa forma, representando um risco de responsabilidade (ou seja, os desenvolvedores que incorporam o código podem ser processados). E, como a IA comete erros, as ferramentas de codificação assistida podem resultar em mais código errado e inseguro sendo enviado para bases de códigos.

Jackson disse que o Supermaven não usa dados do cliente para treinar seus modelos. Ele admitiu, no entanto, que a empresa retém dados por uma semana para “tornar o sistema rápido e responsivo”, disse ele. Sobre direitos autorais, Jackson não negou explicitamente que o Babble foi treinado em código protegido por propriedade intelectual - apenas que foi “treinado quase exclusivamente em código publicamente disponível em vez de um scrape da internet pública” para “diminuir a exposição a conteúdo tóxico durante o treinamento.”

Os clientes não parecem estar desencorajados. Mais de 35.000 desenvolvedores estão usando o Supermaven, diz Jackson, e uma parcela considerável está pagando pelos planos Pro ($10 por mês) e Team ($10 por usuário por mês) premium. A receita recorrente anual do Supermaven atingiu US$ 1 milhão neste ano, com base em uma base de usuários que cresceu 3x desde o lançamento da plataforma em fevereiro.

Esse ímpeto chamou a atenção dos investidores de capital de risco. O Supermaven anunciou esta semana seu primeiro financiamento externo: uma rodada de $12 milhões liderada pela Bessemer Venture Partners e investidores anjo de alto perfil, incluindo o co-fundador da OpenAI, John Schulman, e o co-fundador da Perplexity, Denis Yarats. Jackson diz que o plano é gastar o dinheiro na contratação de desenvolvedores (o Supermaven tem atualmente uma equipe de cinco pessoas) e no desenvolvimento do editor de texto do Supermaven, que está atualmente em beta.

“Planejamos crescer significativamente até o final do ano”, acrescentou. “Apesar dos ventos contrários para a tecnologia em geral, o mercado de copilotos de codificação vem crescendo rapidamente. Nosso crescimento desde o lançamento em fevereiro - bem como nossa rodada de financiamento mais recente - nos posicionam bem à medida que avançamos para o próximo ano.”